GA4を開いてスクショを撮り、Google広告の数字をコピーし、Search Consoleのデータを貼り付けて前月比を計算する。毎月この作業に3時間。3クライアントぶんだと10時間近い。

僕はこの作業を、n8nとLooker Studioで完全に自動化した。今は月1時間。やることは「データを見て、打ち手を考える」だけ。

この記事では、GA4のデータ収集からLooker Studioでの自動レポート出力まで、n8nを使って構築する具体的な手順を書いていく。コードを書かないノーコードの方法だ。「Looker Studio 自動レポート」で検索してたどり着いた人も、GA4レポートの自動化を探していた人も、ここに答えがある。

「レポートを作る」と「レポートを読む」は別の仕事

ここを混同している人がものすごく多い。

レポート作成は、データの収集・転記・集計・グラフ化。完全に機械がやるべき仕事だ。分析は、数字から課題を見つけて次のアクションを考える作業。これが人間の仕事。

McKinseyの調査によると、データ関連業務のうち約60%が「収集・加工・整形」に費やされている。分析に使われている時間はわずか20%前後。つまりデータを「見る」前の準備で大半の時間が溶けている。

これは個人のスキルの問題じゃない。仕組みの問題。

なぜn8nを選んだのか──3つの自動化手段を比較する

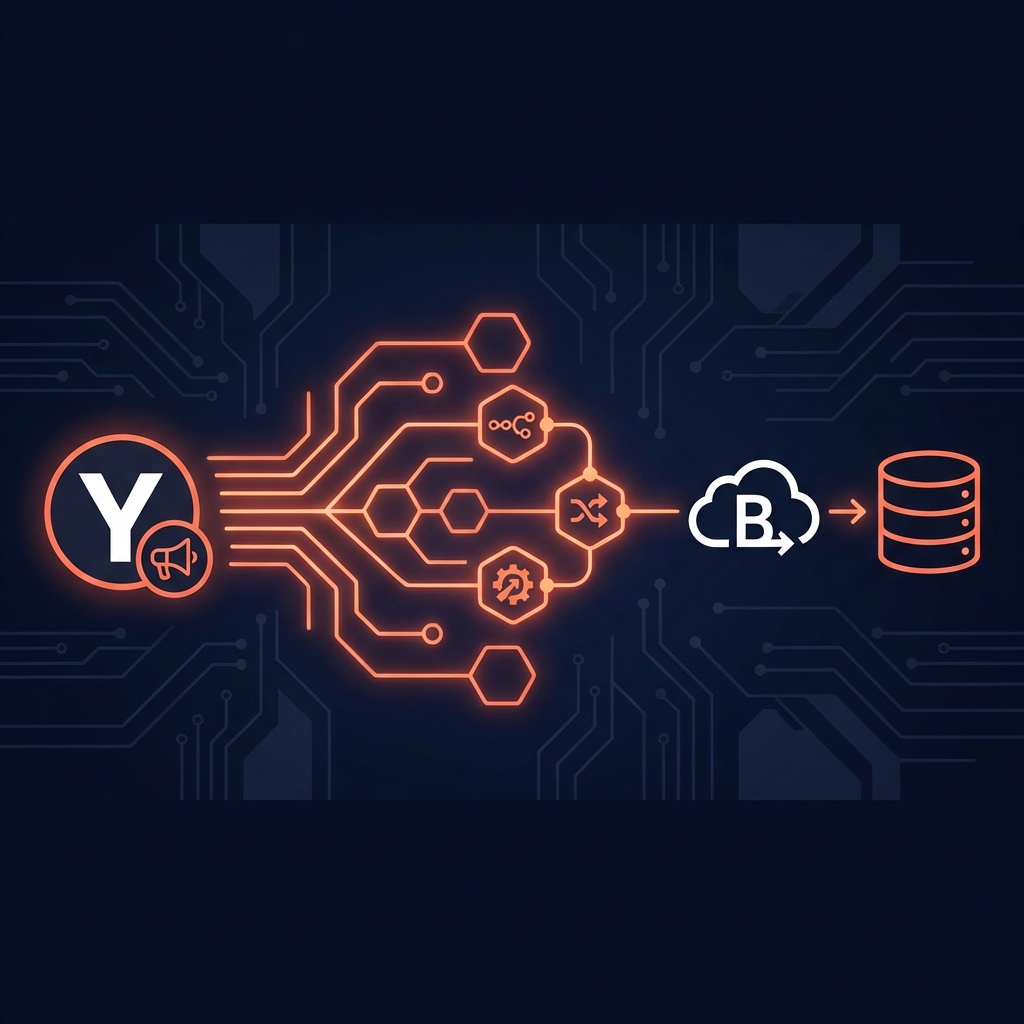

GA4のデータ収集を自動化する方法は、大きく3つある。Google Apps Script、BigQuery、そしてn8nのようなノーコード自動化ツール。僕は最終的にn8nを選んだけど、それぞれの特徴を整理しておく。

Google Apps Script(GAS)で組む方法。 GA4 Data APIをGASから叩いて、Googleスプレッドシートに書き出す。Googleのエコシステムに閉じているので認証まわりがラク。半日あれば動くものが作れる。ただし、GA4以外のデータソース(Yahoo!広告やSNSのAPI)を追加するたびにスクリプトを書き足す必要がある。データソースが3つ、4つと増えてくると、メンテナンスがじわじわつらくなる。

BigQueryを経由する方法。 GA4にはBigQueryエクスポートという機能がある。これを有効にすると、GA4のローデータ(生データ)が毎日BigQueryに自動で流れる。Looker Studioから直接BigQueryを参照すれば、データ収集の自動化は完了。大量データの分析には最強の選択肢だ。ただし、BigQueryはSQLを書ける人がいないとカスタムレポートが作れない。月間数百万PVを超えるサイトだとクエリ課金も気になってくる。中小企業の月次レポート用途には、正直オーバースペック。

n8nで組む方法。 n8n(エヌエイトエヌ)は、オープンソースのワークフロー自動化ツール。ノードと呼ばれるブロックをつないでデータの流れを視覚的に設計できる。GA4、Search Console、Google広告、Yahoo!広告、Slack──データソースの追加はノードを1つ足すだけ。コードを書かずにAPIの認証もGUI上で完結する。セルフホスト(自分のサーバーで動かす方式)なら月額無料。クラウド版でも月$20から使える。

僕がn8nを選んだ理由は単純で、「データソースが増えてもメンテが増えない」から。GASだとスクリプトの行数が膨らむし、BigQueryだとSQL文の管理が必要になる。n8nなら、フローチャートを見ればデータの流れが一目でわかる。半年後の自分が「これ何やってるんだっけ」とならない。これが決め手だった。

n8nでGA4データ自動取得を構築する手順

ここからが本題。n8nを使ってGA4のデータを自動で取得し、Googleスプレッドシートに蓄積するまでの具体的な手順を書いていく。

事前準備:Google Cloud ConsoleでAPIを有効化する

n8nからGA4のデータを引っ張るには、Google側で「外部からのアクセスを許可する設定」が必要になる。

Google Cloud Consoleにログインして、「APIとサービス」からGA4 Data APIを有効化する。次に、OAuth 2.0のクライアントIDを作成。これはn8n側でGoogleアカウントと認証するために使う鍵のようなもの。クライアントIDとクライアントシークレットの2つの文字列が発行されるので、控えておく。

(ちなみに、この認証設定が全工程でいちばん面倒なパート。ここを乗り越えれば、あとは流れ作業。)

ステップ1:n8nでGA4 APIノードを設定する

n8nのワークフローエディタを開いて、新しいワークフローを作成する。

最初に追加するのはScheduleトリガーノード。これは「いつ自動実行するか」を決めるノードで、Cron式(定期実行の書式)で「毎朝6時」に設定する。設定値は 0 6 * * *。月次レポートなら毎月1日の朝に実行する設定(0 6 1 * *)でもいい。

次に、Google Analytics 4ノードを追加する。ここで先ほど控えたOAuth 2.0のクライアントIDとシークレットを使ってCredential(認証情報)を登録する。n8nの画面上で「Connect my account」をクリックすると、Googleのログイン画面が表示される。GA4の閲覧権限があるアカウントで認証すれば接続完了。

ノードの設定項目はこの3つ。

Property ID。 GA4のプロパティIDを指定する。GA4の管理画面「プロパティ設定」に表示されている9桁の数字。

ディメンション。 データの「切り口」を指定する。日付別に見たいなら date、ページ別なら pagePath、流入経路別なら sessionDefaultChannelGroup。複数指定できる。

メトリクス。 取得したい「数値」を指定する。セッション数なら sessions、ユーザー数なら totalUsers、ページビューなら screenPageViews、コンバージョン数なら conversions。これも複数指定できる。

日付範囲は startDate と endDate で指定する。「過去30日ぶん」なら 30daysAgo と today を入れればいい。n8nのExpression機能を使えば、実行日から動的に計算させることもできる。

ステップ2:Search Console・Google広告のノードを追加する

GA4ノードの設定が終わったら、同じ要領でSearch ConsoleノードとGoogle Adsノードを追加する。

Search Consoleノードでは、表示回数・クリック数・CTR(検索結果でのクリック率)・平均掲載順位を取得する。クエリ別、ページ別、日付別に切り出せる。

Google Adsノードでは、キャンペーン別のCV数・CPA(1件あたりの獲得コスト)・消化額・ROAS(広告費用対効果)を取得する。

ポイントは、各ノードを並列に配置すること。GA4 → Search Console → Google Ads の直列ではなく、Scheduleトリガーから3つのノードに同時に分岐させる。こうすることでデータ取得が並列実行されて、全体の処理時間が短縮される。

ステップ3:Googleスプレッドシートに書き出す

取得したデータをGoogleスプレッドシートに書き出す。n8nのGoogle Sheetsノードを使う。

書き出し先のスプレッドシートを事前に作っておく。シートは「GA4」「SearchConsole」「Ads」の3つに分ける。各シートの1行目にヘッダー(日付、セッション数、ユーザー数...)を入れておけば、n8nがヘッダーに合わせてデータを追記してくれる。

ここで地味に大事なのが「Append」モードにすること。「Update」だと既存データが上書きされる。Appendなら毎回新しい行にデータが追加されるので、過去のデータが消えない。3ヶ月前、半年前、1年前との比較が一瞬でできるようになる。

ステップ4:エラー通知をSlackに飛ばす

データ取得が失敗したまま気づかない──これがいちばん怖い。「先月のデータ、取れてなかったんですけど」と月末に発覚するパターン。

n8nにはError Triggerという仕組みがある。ワークフローのどこかでエラーが発生したら、自動でSlack通知を飛ばせる。Slackノードを追加して、通知先のチャンネルとメッセージテンプレートを設定するだけ。5分で終わる。

僕は #alert-data というチャンネルを作って、そこにエラー通知を集約している。朝起きてSlackを見て、通知がなければ「今日もデータは正常に取れている」とわかる。

Looker Studioでレポートを「開くだけ」にする

データがGoogleスプレッドシートに蓄積される仕組みができたら、次はLooker Studio(旧データポータル)との連携。ここまでやると、レポートは「作るもの」から「開くだけで最新のもの」に変わる。

Looker Studioでの設定はシンプル。新しいレポートを作成し、データソースとしてGoogleスプレッドシートを追加する。n8nが書き出している3つのシート(GA4、SearchConsole、Ads)をそれぞれデータソースとして登録する。

あとはグラフやスコアカードを配置していく。日別セッション数の折れ線グラフ、流入経路別のセッション比率、検索クエリ別のクリック数ランキング、広告キャンペーン別のCPA比較。必要なパーツを一度作れば、データが更新されるたびにグラフも自動で変わる。

Looker Studioの自動レポートで地味に便利なのが「日付範囲コントロール」。レポート閲覧者が「先月」「過去90日」「前年同月」と自由に期間を切り替えられる。Excelで毎回作り直していたあの前月比グラフ、もう不要。

Looker Studioのレポートには共有URLを発行できるので、クライアントにURLを1つ送れば「いつでも最新のレポートが見られる状態」が完成する。月末にPDFを書き出して送る作業すらなくなる。

(余談だけど、Looker Studioのダッシュボードをクライアントに見せたとき、「え、これ毎朝データ更新されてるんですか?」と驚かれた。リアルタイムに近いデータ更新ができているのに、裏側はn8nのフローが毎朝1回動いているだけ。仕組みは地味でいい。)

Before / After

Before(毎月の作業)

- GA4にログイン → データをエクスポート(15分)

- Search Consoleにログイン → データをエクスポート(15分)

- Google広告にログイン → データをエクスポート(15分)

- Yahoo!広告にも同じことを繰り返す(15分)

- Excelに貼り付け → 前月比を手計算(30分)

- グラフを作成・フォーマット調整(30分)

- 報告資料にまとめて体裁を整える(60分)

合計:約3時間/月 x 3クライアント = 9〜10時間/月

After(毎月の作業)

- Looker Studioを開く(データは自動で最新に更新済み)

- 変動が大きい項目を確認する

- 原因と打ち手を考える

合計:約1時間/月

差し引き、毎月8〜9時間の工数削減。年間で100時間以上。丸4日ぶんの営業日が浮く計算になる。

構築コストとROI

初期構築にかかる時間は、自分でやるなら1〜2日。n8nのフロー設計が半日、GA4 APIの認証設定に2〜3時間、Looker Studioのダッシュボード構築に半日。外注する場合は5〜15万円が相場。

月額ランニングコストは、n8nをセルフホスト(自分のサーバーで稼働)するなら実質ゼロ。クラウド版のn8nを使っても月$20〜。Looker Studioは無料。Googleスプレッドシートも無料。トータルで月額数百円〜数千円に収まる。

経営者の時給を5,000円とする(控えめな見積もり)。年間100時間の削減は50万円のコスト減。初期投資が外注でも最大15万円なら、3〜4ヶ月で回収できる。ROIは年間333%。

Zapierの2024年State of Business Automationレポートによると、「週2時間以上の繰り返し作業がある」と回答した企業の94%が、自動化導入後に生産性の向上を実感している。レポート作成は、自動化のROIがもっとも見えやすい領域の一つだ。

「自動化なんて、うちにはまだ早い」への反論

この話をすると、必ずこう言われる。「うちは規模が小さいから、自動化するほどの量じゃない。」

2つの意味で間違っている。

規模が小さいほど恩恵が大きい。 大企業にはレポート作成の専任担当者がいる。中小企業にはいない。経営者本人がやっている。つまり自動化で浮くのは、もっともコストの高い人材──経営者の時間だ。

量ではなく「頻度」の問題。 月1回のレポートは大した量じゃないかもしれない。でも12ヶ月 x 3年で36回。36回同じ作業を手でやるのか。小さな作業でも、繰り返すなら自動化する価値がある。

次のステップ

この記事で紹介した構成(n8n + Googleスプレッドシート + Looker Studio)は、レポート自動化のベースラインにすぎない。ここから先はいくつかの拡張ができる。

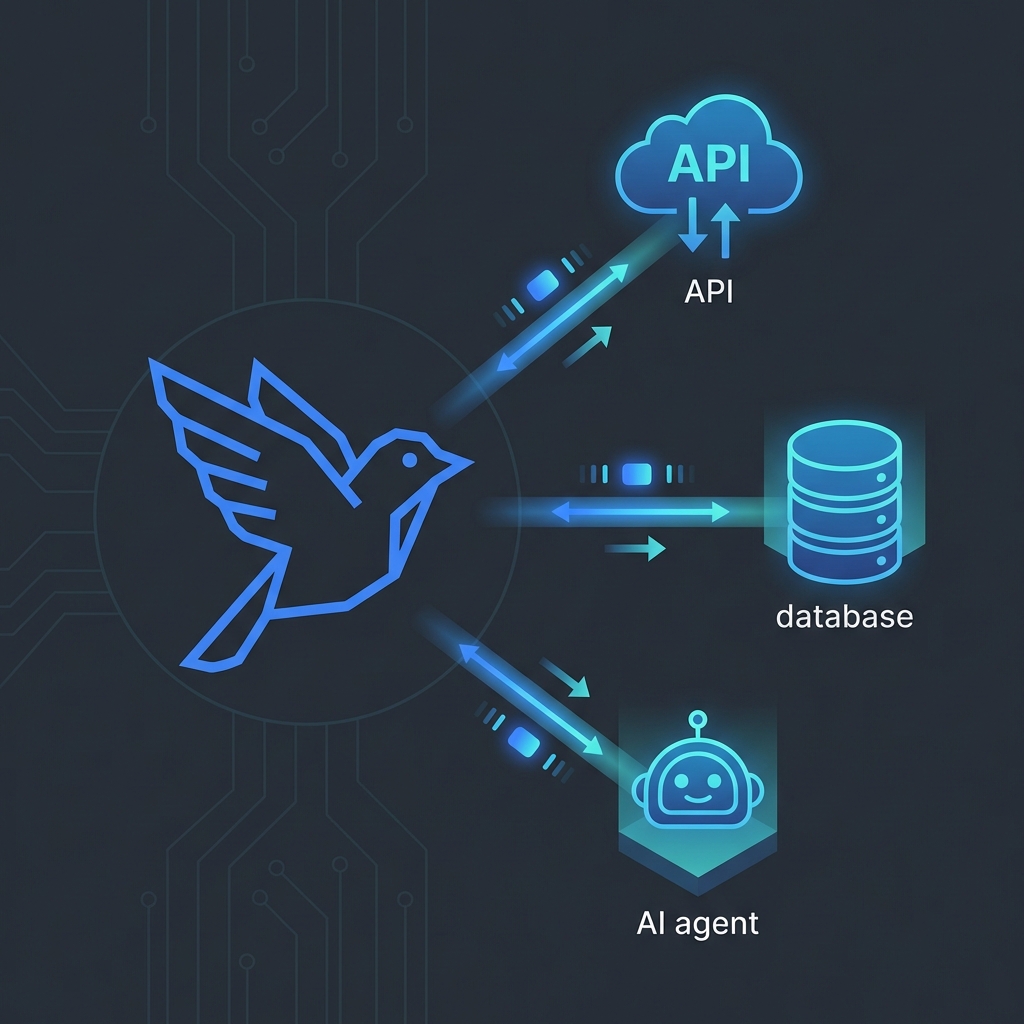

n8nの自動化フローにAIのステップを追加すれば、データの異常値検知や簡易サマリの自動生成も可能になる。MCPサーバーを使ったツール連携については、MCPの仕組みと使い方の解説記事で詳しく書いている。

SEOまわりの計測を自動化したい場合は、SEOの自動計測と改善の記事が参考になるはず。Search ConsoleのAPIから取得したデータをn8nで加工して、検索順位の変動をSlackに自動通知する──という応用例もそこで紹介している。

ワークフロー自動化にAIエージェントを組み込むアーキテクチャについては、Dify MCPの活用記事にまとめた。n8nとDifyを組み合わせると、データ収集だけでなく分析の一部まで自動化できる。

経営者の仕事は、データを集めることじゃない。データから意思決定をすること。集める作業は仕組みに任せて、自分は「読んで、考えて、動く」に集中する。

Googleの元CEOエリック・シュミットは「データが答えを持っている。問題は、正しい問いを立てられるかだ」と語った。レポート作成に毎月10時間を費やしている状態では、「正しい問い」を考える余裕すら生まれない。

まずはn8nをインストールして、GA4のデータ取得フローを1本作ってみてほしい。所要時間は半日。それだけで、来月の月末がまるで変わる。

参考文献

- McKinsey Global Institute「The age of analytics: Competing in a data-driven world」 https://www.mckinsey.com/capabilities/quantumblack/our-insights/the-age-of-analytics-competing-in-a-data-driven-world

- Google「GA4 Data API の概要」 https://developers.google.com/analytics/devguides/reporting/data/v1

- Google「Search Console API」 https://developers.google.com/webmaster-tools/v1/how-tos/search_analytics

- n8n公式ドキュメント「Google Analytics 4 Node」 https://docs.n8n.io/integrations/builtin/app-nodes/n8n-nodes-base.googleanalytics/

- Looker Studio ヘルプ「Google スプレッドシートに接続する」 https://support.google.com/looker-studio/answer/7020322

- Zapier「The State of Business Automation 2024」 https://zapier.com/blog/state-of-business-automation/

- Eric Schmidt, Jonathan Rosenberg『How Google Works――私たちの働き方とマネジメント』(日経ビジネス人文庫)