月の広告費の15%がムダだった。

これは僕が、あるクライアントのGoogle広告アカウントを3週間分のCV(コンバージョン、つまり問い合わせや申し込み)データで比較したときに出てきた数字だ。月予算60万円のうち、約9万円。年間にすると54万円。「なんとなく均等に配分してるだけ」の予算運用が生んだ金額としては、笑えない。

で、問題はここからだ。「ムダがある」と分かっても、毎週手動でスプレッドシートにデータを引っ張ってきて比較する──それを続けられる人間が何人いるか。僕は3週間で挫折した。正直に言う。

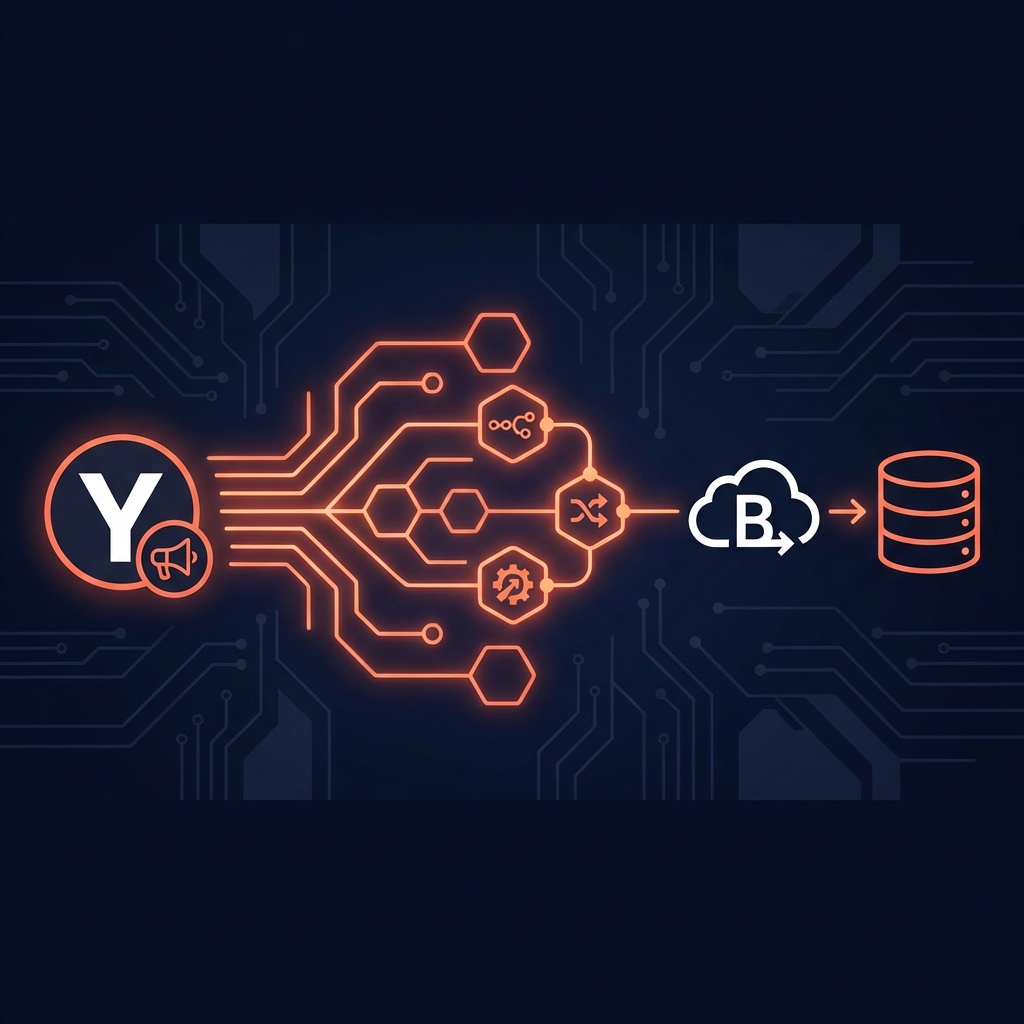

だからn8n(エヌエイトエヌ)で自動化した。

「週次CV比較」を人力でやる限界

話を少し戻す。そもそも週次でCV比較をやる意味について。

Google広告の管理画面は月単位のデータを見やすくできている。でも月単位だと「先月よりCPA(1件あたりの獲得コスト)が上がった」と分かったときには、もう3〜4週分の予算が溶けた後だ。遅い。

週単位なら「あれ、このキャンペーン今週CVゼロじゃん」と気づける。1週間分のムダで済む。理屈としては単純な話で、広告運用をやっている人なら誰でも知っている。

知っているけど、やらない。なぜか。面倒だからだ。

Google広告の管理画面からCSVをダウンロードして、前週と並べて、差分を見て、気づきをメモして、代理店に共有する。これを毎週月曜の朝にやる? 無理。僕は月曜の朝、コーヒーを淹れるので精一杯だ。

n8nワークフローで週次比較を「勝手にやる」仕組み

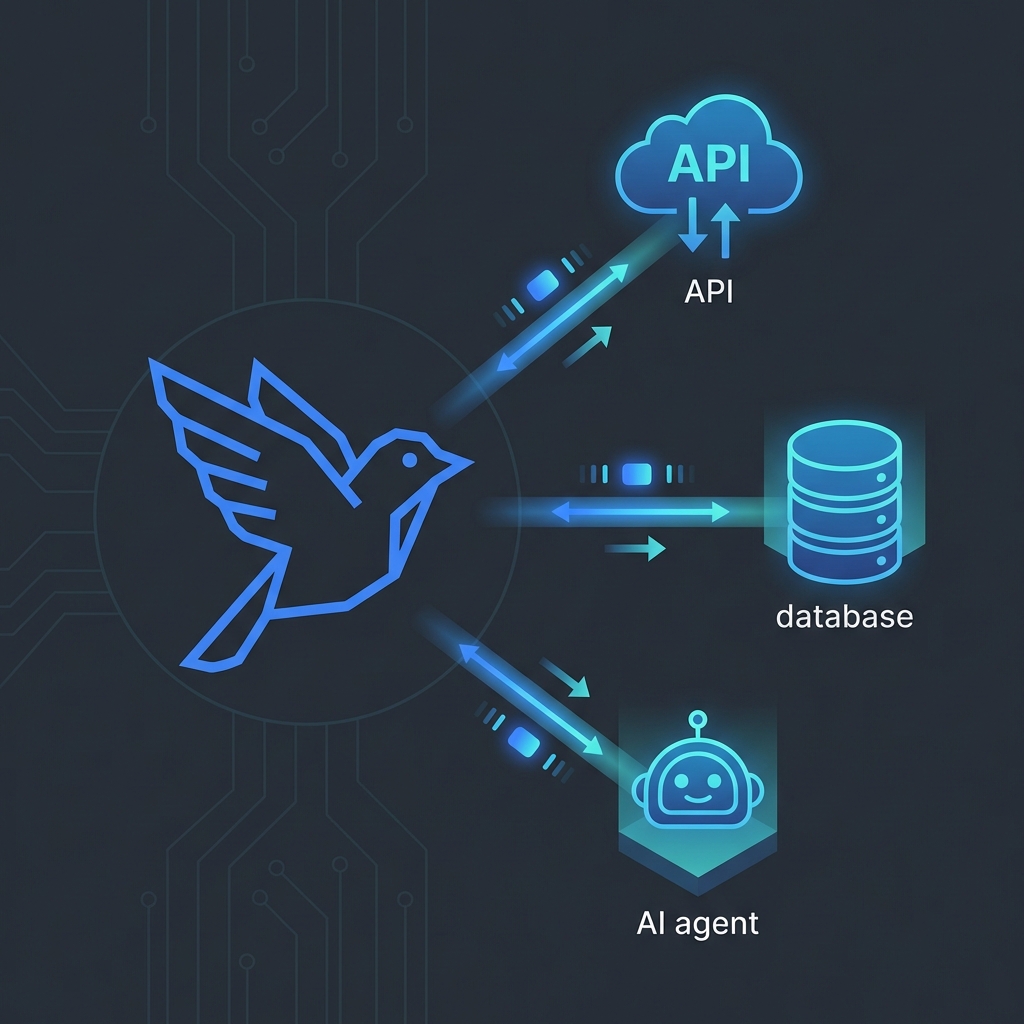

n8nはオープンソースの自動化ツールで、ノーコードでワークフローが組める。Zapierみたいなものだけど、セルフホストできるから月額コストを抑えられる。

僕が組んだワークフローはこうだ。

ノード構成:3ステップ

1つ目のノード、Google Ads APIから直近7日間と前7日間のキャンペーン別CVデータを取得する。Google Ads APIノードはn8nに標準搭載されていて、OAuth認証を通せばすぐ使える。取得する指標はCV数、CPA、費用、インプレッション。キャンペーンID単位で引っ張る。

2つ目のノード、Googleスプレッドシートに書き込む。前週比を計算するFunction Nodeを間に挟んで、「CV増減率」「CPA増減率」を自動算出。これをスプレッドシートの「週次ログ」シートに1行ずつ追記していく。3週間分溜まると、トレンドが見える。

3つ目のノード、Slack通知。CV増減率がマイナス20%を超えたキャンペーンだけをピックアップして、#ads-alertチャンネルに投げる。全キャンペーンの結果を垂れ流すと誰も読まない。異常値だけ飛ばすのがコツだ。

このワークフローをCronトリガーで毎週月曜AM9:00に発火させる。僕がコーヒーを淹れている間に、データ取得から異常検知まで終わっている。

──ちなみにn8nのセットアップ手順やノードの細かい設定は、別記事「n8n自動化ガイド(日本語版)」にまとめているので、初めての人はそっちから読んだほうがいい。

自動化して最初の3週間で起きたこと

ワークフローを回し始めて1週目。Slack通知が飛んできた。

「キャンペーンC:CV前週比 -100%(0件)、費用 ¥38,000」

週3.8万円。月換算で15万円。CVゼロのキャンペーンに毎月15万円流していた計算になる。管理画面で月次レポートだけ見ていたときは、このキャンペーンのCVは「月2件」と表示されていた。2件あるなら止めるほどでもないか、とスルーしていた。

でも週次で見ると景色が変わる。月前半にたまたま2件取れて、後半はゼロ。ムラが激しい。これは「たまたま2件」であって「安定して月2件」ではない。

2週目、別のSlack通知。

「キャンペーンA(東京):CPA前週比 +45%」

東京エリアのCPAが急騰していた。調べたら競合が入札を上げてきたタイミングだった。東京は競合が多いから、入札合戦に巻き込まれやすい。

3週目、ここで手を打った。キャンペーンCの予算をキャンペーンAの東京以外のエリア(神奈川・千葉・埼玉)に振り替えた。東京は競合が高騰しているから無理に追わない。結果、翌月のCV数は前月比で1.5倍になった。

この判断、月次レポートだけ見ていたら絶対にできなかった。

Looker Studioで「見える化」する意味

Slack通知だけでも回るけど、代理店との打ち合わせで「データを見せる」場面がある。そのときにSlackのスクショを貼り付けるのはかっこ悪い。

Looker Studio(旧Googleデータポータル)でダッシュボードを組んでおく。データソースはさっきのGoogleスプレッドシート。n8nが毎週書き込むシートをそのまま参照する。

ダッシュボードに載せるのは3つだけ。週次CV推移の折れ線グラフ、キャンペーン別CPA比較の棒グラフ、異常値アラートの一覧。これで十分。凝ったダッシュボードを作ろうとすると構築に2日かかって、結局誰も見ない。3つに絞る。

自分でダッシュボードを持つと、代理店との会話が変わる。「先週のCV、キャンペーンBだけ落ちてますよね。何かありました?」と聞けるようになる。代理店の月次レポートを待って、届いたPDFを読んで、疑問点を整理して、次の打ち合わせで聞く──その往復が消える。

GA4のレポートをn8nで自動生成する方法は「GA4レポートをn8nで自動化する手順」にまとめている。Google広告とGA4のデータを1つのダッシュボードに集約すると、広告流入後のサイト内行動まで追える。

自動入札と手動入札の使い分け──tCPA・tROASの落とし穴

ここでもう1つ触れておきたいのが、Google広告の自動入札戦略だ。

tCPA(目標コンバージョン単価)やtROAS(目標広告費用対効果)を使えば、Googleの機械学習が入札を自動で調整してくれる。「全部Googleに任せれば? n8nいらないじゃん」と思うかもしれない。

半分正しくて、半分間違っている。

自動入札が力を発揮するのは、月30件以上のCVがあるキャンペーンだ。Googleの機械学習はデータ量がないと学習できない。月5件のキャンペーンでtCPAを設定すると、入札が暴れる。高すぎたり低すぎたり、安定しない。

僕の使い分けはこうだ。月CV30件以上のキャンペーンはtCPAに任せる。月CV30件未満は手動入札(拡張CPC)で、週次データを見ながら自分で調整する。この「月CV30件未満」のキャンペーンこそ、n8nの週次監視が効く。自動入札に任せられないから、自分の目で見る。でも手動で見るのは面倒だから、n8nにデータ収集だけやらせる。

tROASはECサイト向けだから、リード獲得型のビジネス(問い合わせや資料請求がゴール)ならtCPAを選ぶ。ここを間違えると最適化の方向がズレる。

代理店に頼らず「自分のデータ」を持つ

──ここまで読んで「代理店に任せてるんだから、代理店がやればよくない?」と思った人もいるだろう。

代理店が悪いと言いたいわけじゃない。僕も代理店出身だからわかる。代理店は1人で10〜20社を担当している。週次で全クライアントのCV比較を手動でやるのは物理的に無理だ。だから月次レポートになる。

でも発注者側が自分でデータを持っていると、「代理店への丸投げ」から「データに基づいた協業」に変わる。代理店が出してきた改善提案に対して「あ、それ先週のデータで見たんですけど、キャンペーンBのCPA上がってるのって競合要因ですよね?」と返せる。代理店側もやりやすい。

n8nもLooker Studioも無料で始められる。n8nのセルフホストはDocker1コマンドで立ち上がる。Looker StudioはGoogleアカウントがあれば使える。コストはほぼゼロだ。

ここで「でも設定が面倒なんでしょ?」という声が聞こえてきそうだけど、正直に言うと、最初のGoogle Ads APIのOAuth認証でつまずく人は多い。GCPのコンソールでプロジェクト作って、APIを有効化して、認証情報を作って──ここだけはちょっとハードルがある。でも一度通せば、あとは同じ認証を使い回せるから、初回だけ踏ん張ればいい。

5つのチェックポイント──週次データで見るべき場所

n8nで自動取得する前提で、Slack通知の条件に組み込むべきポイントを5つ挙げる。

1. CVゼロのキャンペーン(週単位) 月次だとCVが「月2件」でも、週次で見るとゼロの週がある。「たまたま2件」なのか「安定した2件」なのか。ここが分かれ道。

2. CPA急騰(前週比+30%以上) 競合の参入、品質スコアの低下、LP(ランディングページ、広告クリック後に最初に表示されるページ)のエラーなど、原因は複数ある。n8nで検知したら、原因を代理店と一緒に調べる。

3. エリア別のCV偏り 全国配信しているなら、都道府県別のCVを見る。東京だけCPAが高くてCVも取れている、埼玉はCPAが安いのにCVゼロ──こういうパターンは意外と多い。エリアを分割して予算を寄せるだけでCVが増える。

4. 曜日・時間帯の偏り BtoB商材なら平日9:00〜18:00にCVが集中するのが普通だ。土日に予算を使う必要があるか? 曜日別データをn8nで取得して、配信スケジュールを見直す。

5. デバイス別のCPA差 PCとスマホでCPAが2倍以上違うなら、入札調整をかける。自動入札を使っていても、デバイス別の傾向は自分で把握しておく。

自分で動かしてみて、初めて分かること

正直、この記事を読んだだけだと「ふーん」で終わる人が大半だと思う。僕だってそうだった。でもn8nのワークフローを1つ組んで、最初のSlack通知が飛んできた瞬間に「あ、これ今まで見逃してたやつだ」と気づく。

広告運用のムダは、見えないから放置される。見える仕組みを作れば、判断が速くなる。判断が速くなれば、ムダが減る。

年間54万円のムダを見つけたあのクライアントは、今は週次データを自分で見ている。代理店との月次ミーティングの空気が変わったと言っていた。「代理店のレポートを待つ側」から「データを持って議論する側」になった、と。

n8nのセットアップに1時間、Looker Studioのダッシュボード構築に2時間。合計3時間で、年間54万円のムダに気づく仕組みが手に入る。高い投資じゃない。